딥페이크 범죄 이어 '딥보이스 피싱' 확산 주의보

경주 A씨 딸 목소리·전번에 600만원 당해

'구글 기프트 카드' 구매 핀 번호 넘겨줘

목소리도 개인 정보, 낯선 전화 답도 마라

#이달 중순 경북 경주시 A씨는 딸로부터 전화를 받았다. 딸의 휴대전화번호가 그대로 였고 자신의 휴대전화에 입력한 ‘공주’도 그대로 였다. 딸이 울먹이는 목소리로 친한 친구가 사채를 쓰고 도망가 자신이 대신 잡혀와 있다는 것이었다. 사채업자가 전화를 바꾸고는 윽박질렀다. 사채업자는 구글 키프트 카드 600만원어치를 구매하라고 했다. A씨는 경주시내를 정신없이 4시간 편의점 곳곳을 돌아다니며(구매 한도가 있음) 구글 기프트 카드를 구매하고 핀 번호를 모두 넘겼다. 이후 한숨 돌리고 다시 딸에게 전화해서 “풀려 났니?”라고 하니, “엄마, 무슨 말이야”라는 답이 돌아왔다. 목소리도 개인 정보, A씨는 그제서야 잘못됐다는 것을 알았다.

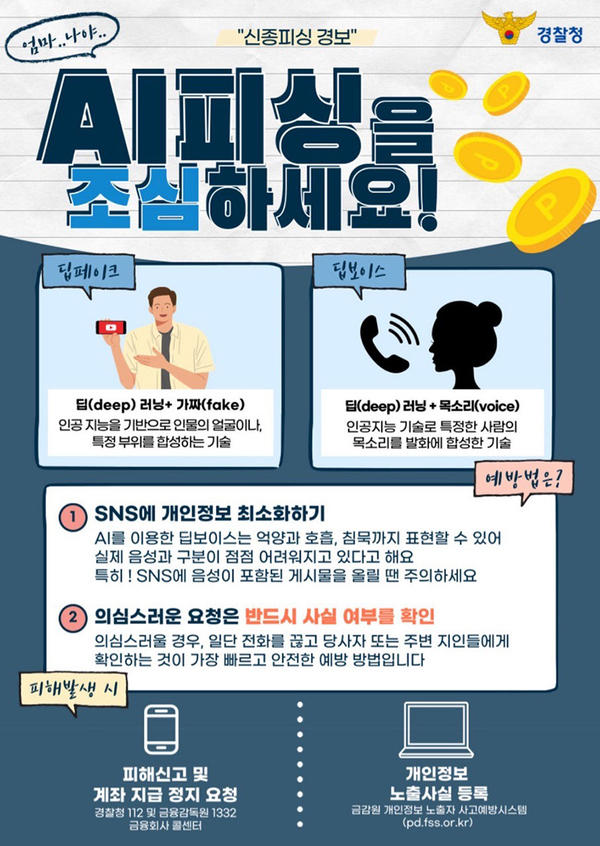

딥페이크 범죄에 이어 목소리를 똑같이 복제해 피해자를 속이는 ‘딥보이스피싱’이 확산되고 있다. 인공지능(AI)를 악용한 범죄가 우리들의 일상을 노리고 있다.‘딥 보이스(Deep Voice)’는 딥러닝(Deep Learning)과 목소리(Voice)의 합성어로 AI 기반 음성 합성 기술이다.

목소리를 복제해 놓고 컴퓨터로 타이핑만 하면 가족도 못 알아차릴 만큼 감쪽 같은 목소리가 변조돼 출력된다. 휴대전화를 해킹해 자신들의 컴퓨터나 복제폰으로 전화를 하면 전화번호도 그대로 뜬다.

아주 적은 양의 목소리 샘플만 있어도 텍스트 입력을 통해 간단하게 음성을 합성 출력할 정도로 인공지능(AI)은 영악해졌다. 음성복제 프로그램은 무료부터 유료 프로그램이 넘쳐 난다.

딥보이스피싱 사건이 빈발하자 국내에서도 이미 경찰청이 딥보이스피싱 주의보를 내린 상태이다.

해외에서도 이미 딥보이스피싱이 빈번하다. 수년 사이 중동 아랍에미리트의 한 은행에서 기존 거래 고객이던 대기업 임원의 전화를 받고 420억 원을 송금했다. 알고보니 해당 기업 임원을 사칭한 딥 보이스 피싱이었다는 사실이 밝혀지기도 했다.

경찰은 우선 낯선 번호로 상대방이 아무말 하지 않는 전화가 온다면 절대 답하면 안된다고 조언한다. 음성을 빼내기 위해 하는 전화일 가능성이 있다는 것이다. 또한 가족끼리 일종의 암호 같은 것을 정해 놓는 것도 한 방법이다.

휴대전화 해킹도 주의해야 한다. 무료 어플을 설치하거나 문자나 SNS 링크를 함무로 클릭하는 것도 금물이다.

금전을 요구하는 전화는 이제 가족 목소리 전번이여도 몇 번이고 의심해야하는 시대가 됐다. 이번 경주 사례처럼 구글 기프크 카드로 범행을 할 경우 계좌번호 송금처럼 은행 직원이 기지를 발휘해 신고하는 미담도 이제 불가능하다.

A씨는 “직장이 있는 포항에 와서 경찰에 신고는 했지만 돈을 다시 찾기는 힘들 것 같다. 보이스피싱이 남의 일인줄 알았는데 막상 당하고 보니 정말 허탈하다”고 했다.

대경일보 기사내용입니다.

일단 황급히 돈 보내라는 전화는 침착하게 사실관계 확인이 먼저입니다.

피해 없도록 부디 조심들 하시기 바랍니다.

위 글 내용을 공유한 지인 중 한 사람이

얼마 전에 폰을 해킹 당했는데

딸과 똑같은 목소리로 전화가 와서

8천만원이 넘는 거금을 사기당했다고 연락이 왔습니다.

천성이 악한이겠지요

일단 전화를 끊으세요

그리고 다시 전화를 걸어서 "이런걸 요구한게맞냐?"

본인확인을 하세요.

어지러운 세상 슬기롭게

살아가야 되네요